728x90

반응형

선형 모델이 있다면 비선형(non-linear) 모델도 존재할 것이다.

비선형 모델은 선형이 아니기 때문에 경사하강법을 이용하는 것이 제한된다.

결괏값 O의 경우 X*W+P 임을 알 수 있다.

실제로 X와 W의 행렬곱을 수행하면 nxp 형태가 되고 이에 보정값 b를 더해준다.

소프트맥스는 모델의 출력을 확률로 해석할 수 있게 변환해 주는 연산.

분류 문제(Classification Problem)를 해결할 때 선형 모델과 결합.

활성함수는 선형모형과 딥러닝을 구분에 주는 중요한 개념이다.

ReLU 함수를 많이 사용한다.

w11~wdp까지 가중치라 생각하면 쉽다. 입력값 x에 대해서 가중치를 곱한 후 b를 더해서 선형 변환을 해준다. 해당 과정을 한번 더 거치면 2층 신경망이 될 수 있다.

해당 과정을 여러번 반복하면 다층 신경망, 해당 함수를 다층 퍼셉트론이라고 한다. 이러한 순차적 신경망 계산을 순 전파라고 부른다.

층을 여러개 쌓는 이유는 층이 깊을수록 목적함수를 근사하는데 필요한 뉴런의 숫자가 훨씬 빨리 줄어들어 효율적인 학습이 가능하기 때문이다.

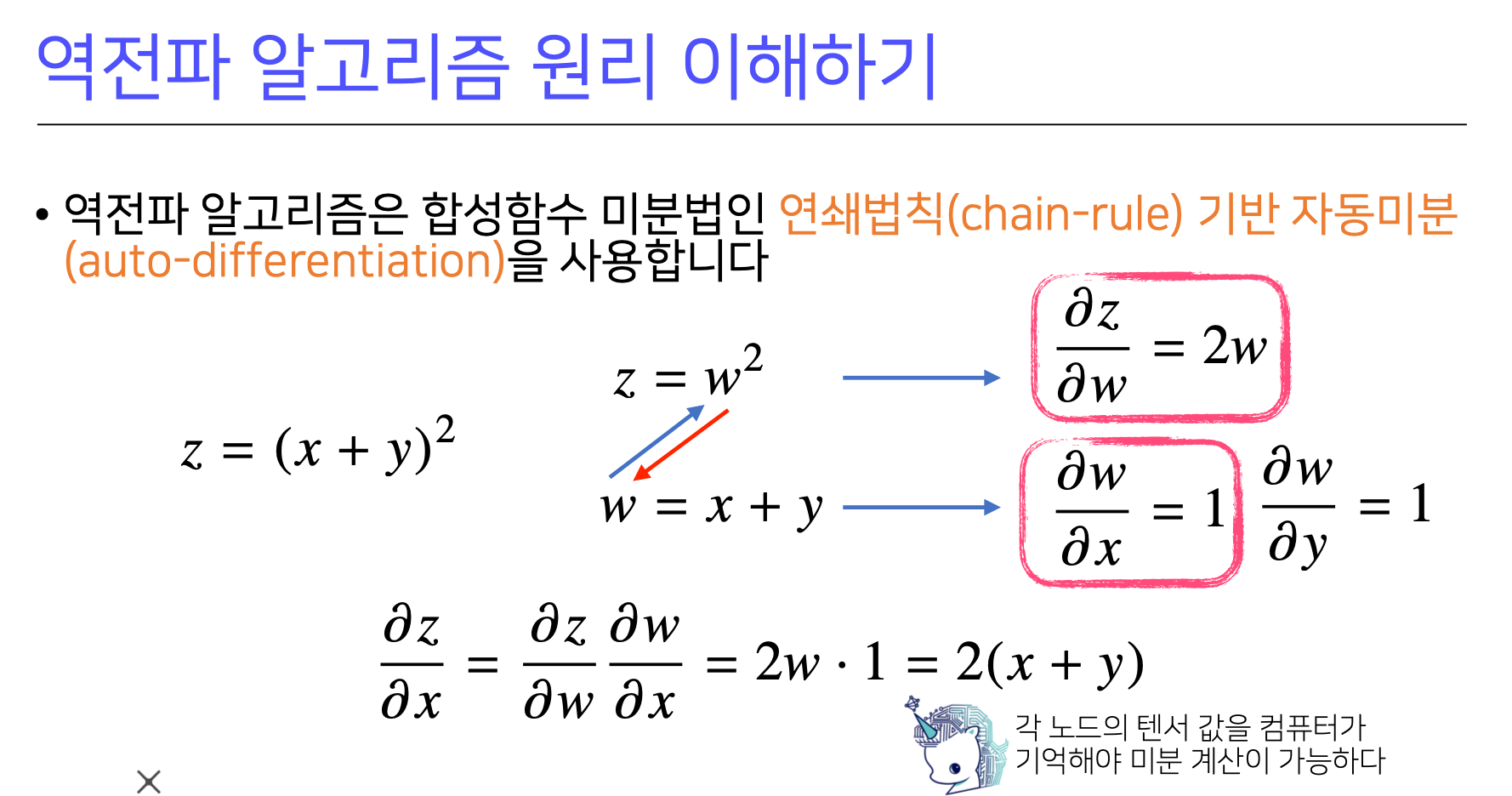

반대로 출력값으로 부터 역방향으로 학습해 나가는 것을 역전파 알고리즘이라고 부른다.

이때 합성함수 미분법인 연쇄 법칙 기반 자동 미분을 활용한다.

728x90

반응형

'AI & Data Science' 카테고리의 다른 글

| BoostCourse AI Pre-Course) Matplotlib (0) | 2022.08.02 |

|---|---|

| BoostCourse AI Pre-Course) 확률론 (0) | 2022.08.02 |

| BoostCourse AI Pre-Course) Pandas (0) | 2022.07.29 |

| BoostCourse AI Pre-Course) 기초 수학(경사하강법) (0) | 2022.07.29 |

| BoostCourse AI Pre-Course) 기초 수학(numpy,벡터,행렬) (0) | 2022.07.26 |